Le developpement explosif des reseaux sociaux et le rythme progressif de l'intelligence artificielle (IA) ont apporte de nombreux avantages mais ont egalement cree des conditions pour que les actes d'abus de technologie soient de plus en plus sophistiques.

Parmi celles-ci la plus preoccupante est que l'IA et la technique deepfake sont utilisees pour se faire passer pour des celebrites afin de profiter de l'exploitation de fraudes et de diffusion d'informations erronees.

Ce probleme devient une obsession pour de nombreux artistes vietnamiens ces derniers temps.

Une serie d'artistes vietnamiens se sont exprimes pour avoir abuse de leur image de cette maniere. Plus recemment Ngo Thanh Van a dû publier un avis d'urgence parce qu'elle avait ete falsifiee par l'IA pour inventer l'histoire qu'elle possedait une villa luxueuse et participait a des publicites pour des produits qui n'etaient pas reels.

L'actrice a partage : 'Je vois de nombreux sites publicitaires et certains contenus sur les reseaux sociaux utiliser mon image mon nom et meme l'IA pour falsifier ma voix afin de les attacher a des histoires qui ne sont pas vraies. De l'allusion au fait que je possede des villas luxueuses des biens riches... a l'adhesion a des produits que je n'ai jamais utilises ou coopere.

Ces informations erronees n'affectent pas seulement l'honneur personnel mais rendent egalement le public confus perdant confiance et meme achetant a tort des produits que je ne fais absolument pas de publicite ni de garantie. Cela me rend vraiment triste'.

Ngo Thanh Van appelle le public a signaler tout contenu contrefait afin d'eviter que les autres ne se meprennent ou ne soient trompes ou ne soient trompes pour acheter des produits de mauvaise qualite.

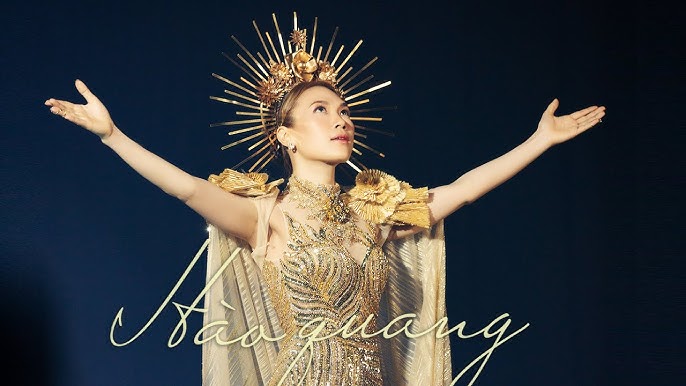

Non seulement Ngo Thanh Van mais My Tam est egalement victime de deepfake (technologie d'imitation du visage et de la voix par l'IA). Dans la soiree du 9 novembre la societe de gestion a dû s'exprimer pour affirmer que la chanteuse ne represente aucun produit en dehors des canaux officiels.

Le representant de My Tam a souligne : 'L'utilisation illegale de l'image et de la voix des artistes a des fins commerciales est une violation de la loi. Nous cooperons avec la plateforme et les autorites competentes pour traiter le probleme.

La presentatrice Hoai Anh a egalement ete creee avec un faux compte Facebook pour se faire passer pour elle afin d'inciter a investir en bourse. L'actrice Hanh Thuy a dû signaler aux autorites competentes pour avoir ete falsifiee pour emprunter de l'argent a des collegues.

Pendant ce temps Hoa Minzy a ete confrontee a plusieurs reprises a une situation d'usurpation d'identite. Debut novembre la chanteuse a de nouveau mis en garde contre le site Web qui utilisait son image pour faire de fausses publicites. Auparavant en avril une personne s'etait egalement fait passer pour sa manager pour signer un contrat de spectacle a Ha Long.

De nombreux autres artistes tels que Lam Truong Tran Thanh Phan Manh Quynh et Khac Viet ont egalement ete pris en photo et en voix pour creer des videos frauduleuses ce qui montre le niveau de propagation de ce probleme.

Selon les statistiques en 2024 les dommages causes par les escroqueries en ligne au Vietnam s'elevent a environ 18 900 milliards de dongs. Un rapport international montre egalement que le deepfake represente environ 6 5 % du nombre total d'escroqueries et que ce taux a augmente de 2137% en 3 ans - un chiffre alarmant.

Les autorites mettent en garde contre le cybercriminel qui renforce l'application de la technologie deepfake et deepvoice pour creer de fausses videos qui ressemblent de plus en plus a la realite difficiles a verifier a l'œil nu.

Dans un contexte ou l'IA peut 'voler l'identite' en quelques secondes seulement les utilisateurs doivent etre particulierement vigilants et ne faire confiance qu'aux informations provenant des chaînes officielles des artistes verifier attentivement les sources de publication avant de transferer de l'argent ou d'acheter des produits signaler immediatement les contenus suspects afin de limiter la propagation.